云从科技发布全球首个百万级“空对空”无人机反无人机追踪基准,重塑低空安全

当追踪者和目标都在低空高速飞行,传统的视觉追踪算法还能跟得住吗?

近日,来自云从科技、上海交通大学、香港科技大学(广州)、中山大学、中国科学院信息工程研究所的联合研究团队发布了一项硬核工作——UAV-Anti-UAV。这是业界首个针对“空对空”(Air-to-Air)场景的百万级多模态反无人机视觉追踪基准,并提出了基于Mamba的强力基线MambaSTS。MambaSTS在UAV-Anti-UAV基准的全部5个指标上均取得最佳的性能,这是云从科技在多模态大模型方面的又一次技术突破。面对双重动态干扰,现有的SOTA表现如何?让我们一探究竟!

01引言:从“上帝视角”到“空中缠斗”

在低空经济蓬勃发展的今天,无人机(UAV)的安全管控已成为全球关注的焦点。反无人机(Anti-UAV)技术应运而生。

然而,回顾现有的视觉追踪研究,我们发现了一个明显的任务盲区(Gap):

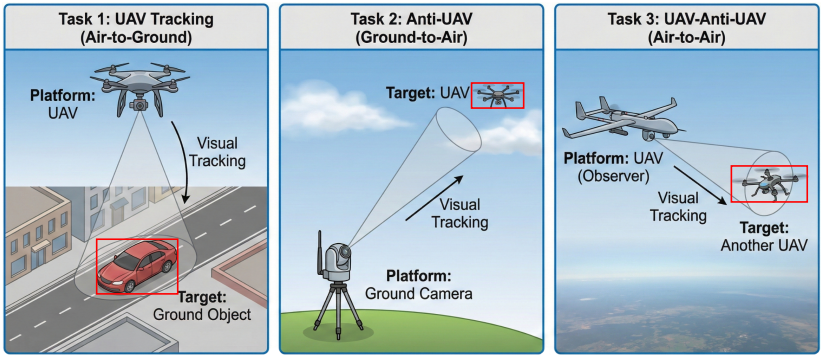

l 传统UAVTracking(空对地):无人机处于“上帝视角”拍摄地面的车辆或行人,虽然相机在动,但目标相对地面运动平稳。

l 现有Anti-UAV(地对空):地面固定的云台/相机仰拍空中的无人机,观察者几乎静止,缺乏运动带来的剧烈抖动

如果是一架无人机在高速飞行中,去追踪另一架试图逃逸的敌对无人机呢?这种场景就像是电影里的空中缠斗(Dogfight)

图1:直观对比了Task1(UAVTracking)、Task2(Anti-UAV)和本文提出的Task3(UAV-Anti-UAV)。Task3中Observer和Target都在低空高速运动。

这就是本文提出的UAV-Anti-UAV(空对空)任务。这是一个双向动态系统:追踪者和目标都在低空高速运动。这带来了前所未有的挑战:严重的双重动态干扰(Dual-dynamicdisturbances)、极速的尺度变化、强烈的运动模糊以及频繁的视角切换。

02数据集:首个百万级、多模态、全场景基准

为了攻克这一难题,研究团队构建了首个大规模基准数据集UAV-Anti-UAVBenchmark。这不只是一个数据集,更是一个低空安全的标准测试床。

数据集由什么构成?

l 规模庞大:包含1,810个视频序列,总帧数高达105万帧,总时长近9.85小时。

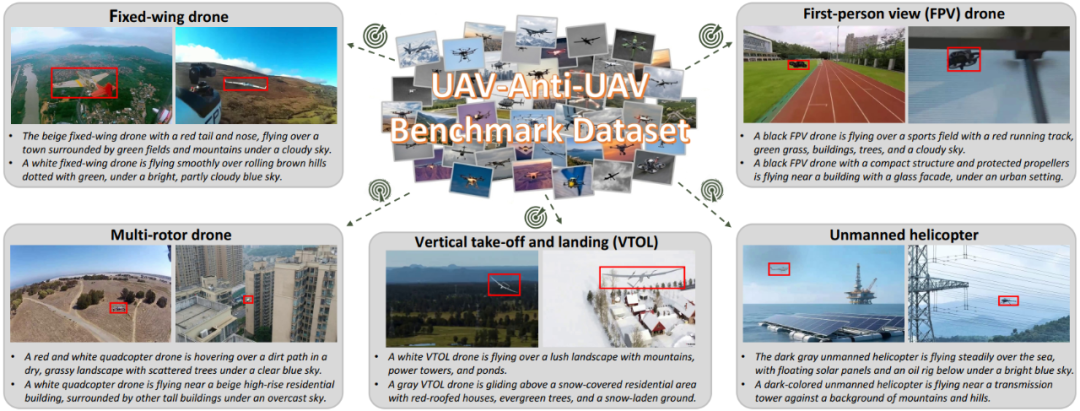

l 机型丰富:涵盖5大类目标,包括固定翼、多旋翼、垂直起降(VTOL)、第一人称视角(FPV)无人机和无人直升机。

l 多模态标注:不仅有精细的边界框(BoundingBox),还提供了自然语言描述(LanguagePrompts),支持视觉-语言追踪研究。

l 细粒度属性:标注了15种极具挑战的属性,如快速运动(FM)、光照变化(IV)、相似干扰物(SD)等。

图2:数据集中包含五种不同类型的无人机目标(固定翼、FPV、多旋翼、垂直起降、无人直升机)以及对应的语言描述。

图2:数据集中包含五种不同类型的无人机目标(固定翼、FPV、多旋翼、垂直起降、无人直升机)以及对应的语言描述。

到底有多难?

相比于现有的数据集,UAV-Anti-UAV是“地狱难度”。

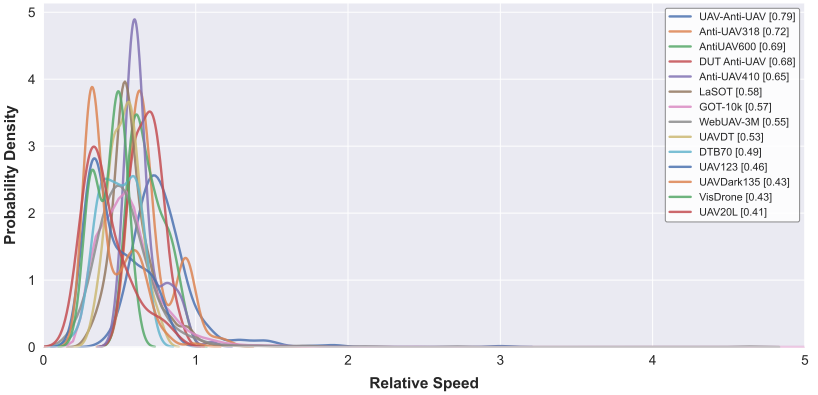

l 相对速度:该数据集的平均相对速度高达0.79,远超现有的UAV123(0.46)和Anti-UAV(0.72)等数据集。

l 目标尺寸:包含大量微小目标(SmallObject),且由于距离变化,尺度变化(ScaleVariation)极其剧烈。

图3:硬核数据证明该数据集在运动强度上的独特性。

图3:硬核数据证明该数据集在运动强度上的独特性。

03方法:MambaSTS——时空语义的完美融合

面对如此高难度的任务,传统的Transformer由于计算复杂度高,难以处理超长序列;而普通的CNN又缺乏全局感知能力。为此,作者提出了新基线:MambaSTS。

这是一个集成了空间(Spatial)、时间(Temporal)、语义(Semantic)学习的统一框架。其核心逻辑在于:利用Mamba(状态空间模型)的线性复杂度优势来建立视频级的长期上下文。

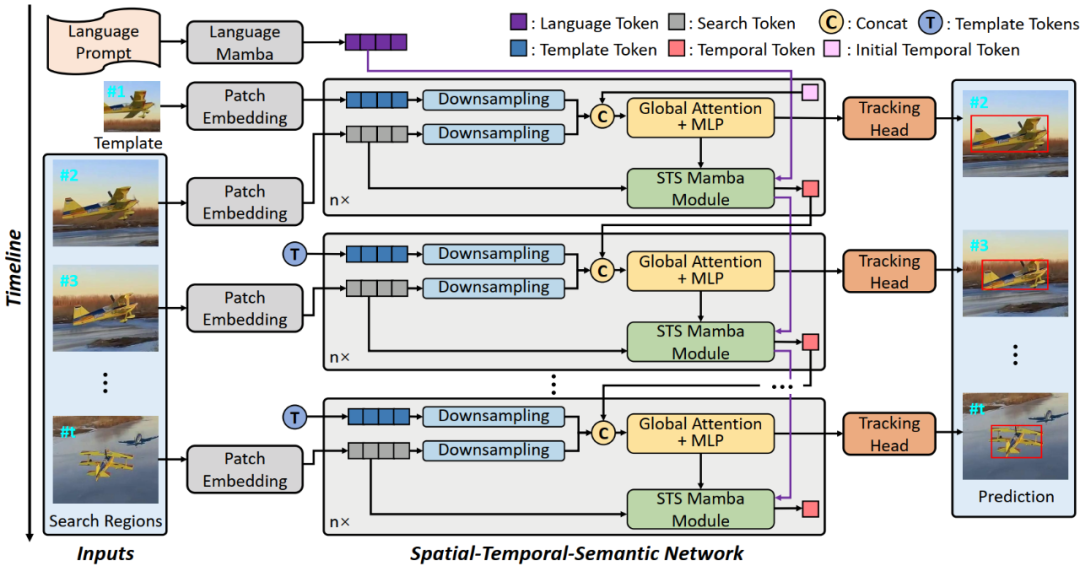

图4:模型主架构图,展示了多模态输入(图像+文本)、STSMamba模块以及层级化的特征提取过程。

图4:模型主架构图,展示了多模态输入(图像+文本)、STSMamba模块以及层级化的特征提取过程。

核心创新点解读:

混合架构(HybridArchitecture):

1. 视觉端:利用分层视觉Transformer(HiViT)提取多尺度特征,捕捉空间细节。

2. 语言端:利用预训练的LanguageMamba提取语义特征,引入文本先验,帮助模型在模糊中“认出”目标。

时间Token传播(TemporalTokenPropagation):

这是本文的“杀手锏”。模型维护一个时间Token,像接力棒一样在帧与帧之间传递。

利用Mamba的选择性扫描机制,将历史帧中目标的轨迹演变和外观变化压缩进这个Token中。这仿佛让模型拥有了“视频记忆”,即便目标被遮挡或模糊,也能基于记忆快速找回。

单向扫描机制(UnidirectionalScanning):

不同于处理静态图像的VisionMamba(Vim)使用双向扫描,MambaSTS针对视频追踪的因果特性(即当前状态只取决于过去),改进为单向扫描,更符合实时追踪逻辑。

04实验:50个追踪器大乱斗,谁是王者?

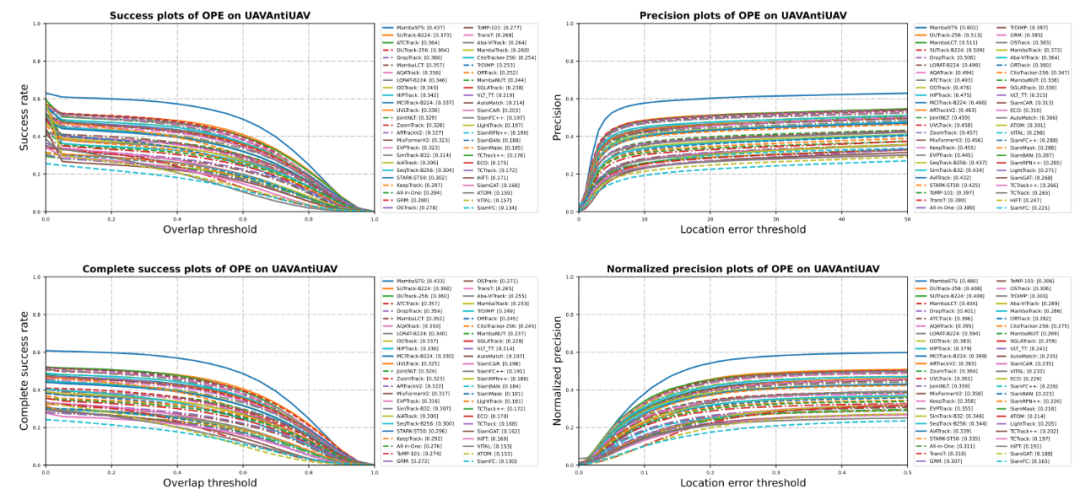

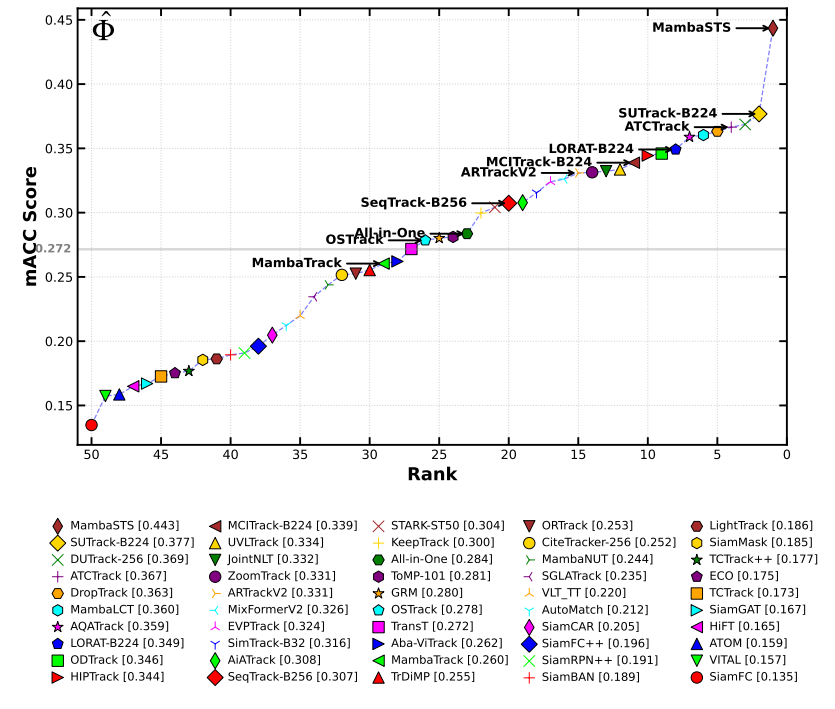

作者对50个现代深度追踪算法进行了全面评测,涵盖了CNN、Transformer、Mamba以及多模态算法(如OSTrack,MixFormer,MambaTrack,CiteTracker等)。

总体战况

l MambaSTS遥遥领先:在所有指标上均取得第一,AUC达到0.437,mACC达到0.443,比第二名高出6.6个百分点。

l 任务难度极大:即便是SOTA的MambaSTS,成功率也仅为40%出头,而所有追踪器的平均AUC仅为0.30左右。这说明UAV-Anti-UAV领域仍是一片蓝海,挑战巨大!

图5:AUC、Precision等指标的曲线图,MambaSTS的曲线(最上方)直观体现了其优势。

图5:AUC、Precision等指标的曲线图,MambaSTS的曲线(最上方)直观体现了其优势。

图6:50个追踪器的mACC排名散点图,MambaSTS位于右上角,大幅领先。

图6:50个追踪器的mACC排名散点图,MambaSTS位于右上角,大幅领先。

属性分析:哪些场景最难搞?

通过对15个属性的细分测试,研究发现:

l MambaSTS的强项:在快速运动(FM)、运动模糊(MB)、小物体(SO)等属性上表现稳健,得益于其强大的时序建模能力。

l 共同的弱点:在光照变化(IV)和全遮挡(FO)场景下,所有模型(包括MambaSTS)都表现挣扎,成功率低于0.15。这指明了未来的优化方向。

图7:具有代表性的属性子图(如FastMotion,MotionBlur,FullOcclusion)。

泛化能力验证

除了在自家数据集上表现出色,MambaSTS在传统的UAVTracking数据集(如UAV123,VisDrone)和地面Anti-UAV数据集上,同样取得了SOTA性能。这证明了该架构并非“过拟合”,而是真正掌握了时空特征的精髓。

05总结与展望

UAV-Anti-UAV任务的提出,标志着低空安全研究向实战化迈出了重要一步。

l 新任务:填补了空对空动态追踪的空白。

l 新数据:百万级规模,多模态标注,为社区提供了标准测试床。

l 新基线:MambaSTS证明了状态空间模型在长序列动态追踪中的巨大潜力。

虽然MambaSTS表现出色,但距离解决全天候、全自主的空中拦截仍有距离(例如缺乏红外/LiDAR数据,且目前为离线训练)。挑战已经摆在面前,各位开发者,你们准备好迎接“空战”了吗?

��开源地址:

https://github.com/983632847/Awesome-Multimodal-Object-Tracking

l 参考论文:ChunhuiZhang,LiLiu,ZhipengZhang,YongWang,HaoWen,XiZhou,ShimingGe,YanfengWang.“HowFarareModernTrackersfromUAV-Anti-UAV?AMillion-ScaleBenchmarkandNewBaseline”,arXiv,2025.

立即下载:

https://arxiv.org/abs/2512.07385

您可能感兴趣

-

2023-10-27

10月24日,华为昇腾AI创新大赛2023全国总决赛在北京国家会议中心隆重举办,云从科技凭借从容大模型训推一体化解决方案,以总成绩第一荣获应用赛道金奖。

-

2025-05-29

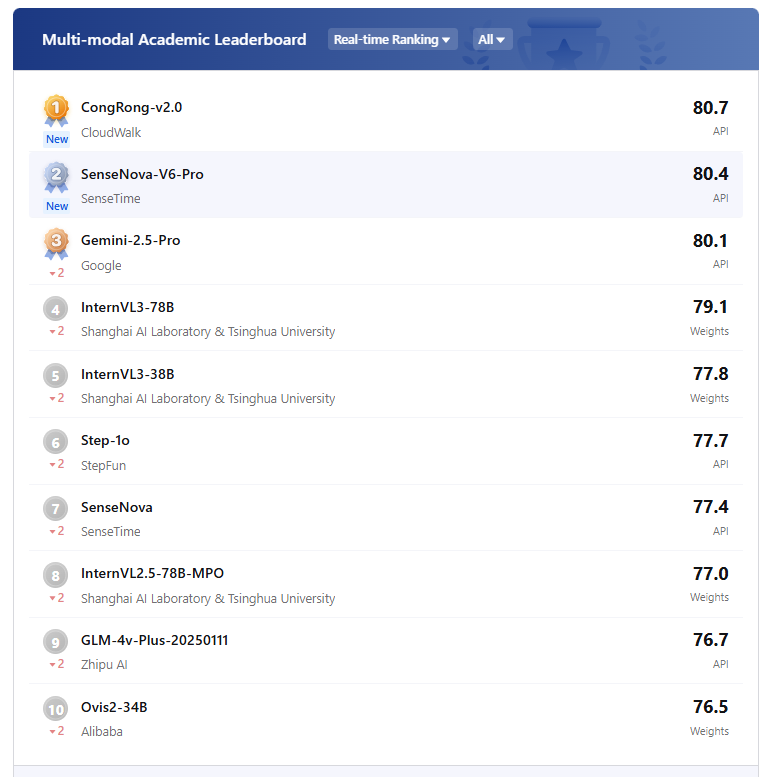

近日,云从科技自主研发的从容大模型在国际权威评测平台OpenCompass最新全球多模态榜单中,以80.7分的综合成绩登顶榜首。

-

2025-07-11

政企协同的科技创新体系正在中国西部加速形成。 在重庆市企业码上服务平台(渝企码)上,某制造企业负责人提出企业需要融资,平台快速识别其融资需求并结合其企业信息快速推荐符合其要求产品,帮助企业快速完成融资申请——这是云从科技作为主要能力输出方为重庆中小企业带来的数字化服务新体验。 近日,重庆市经济信息委公布2025年人工智能典型应用案例名单,云从科技“面向数字化、智能化治理的银河人工智能与智能体服务平台”成功入选,标志着云从在推动区域产业智能化升级方面取得重大突破。